Der AI Act: Eine kritische Einordnung

Am 21.05.2024 war es soweit. Die Europäische Union verabschiedet — nach einigem hin und her — die weltweit erste derart umfassende Regulation von Künstlicher Intelligenz.

Erwartung und Anspruch sind riesig. Das Ziel: Europa als Zentrum der Welt für vertrauenswürdige KI, ein Brüssel-Effekt à la DSGVO.

Dieser erste Artikel widmet sich daher der Frage, welche rechtspolitische Richtung Europa mit dem sogenannten AI Act im globalen Vergleich anschlägt. Wie gelingt die Balance zwischen zweifellos notwendiger Regulierung von KI-Technologie und der zugegebenermaßen EU-typischen Überregulierung. Wie genau sieht der Kompromiss aus, auf den sich die Mitgliedsstaaten diesen Monat haben einigen können?

Türöffner: KI-Definition

Eine Regulation diesen Ausmaßes kommt um eine Definition des Gegenstandes, der reguliert werden soll, nicht herum. Doch schon hier kommen selbst die verständigsten und eifrigsten Brüsselianer ins Schwitzen. Was ist diese KI eigentlich? Was unterscheidet sie zu “normaler” Software?

Der extrem rasante technologische Fortschritt in der Branche und der Umstand, dass jede ToDo-App sich dieser Zeit den Stempel “KI” aufdrückt, macht die Sache für unsere Berufspolitiker natürlich nicht unbedingt leichter.

Doch eine vertretbare Lösung musste her. So einigte man sich schließlich auf folgende etwas ausschweifende Definition in Artikel 3 Absatz 1 der Verordnung, die sich stark an der aktuellen OECD-Definition orientiert:

(1) “KI-System”: ein maschinengestütztes System, das so konzipiert ist, dass es mit unterschiedlichem Grad an Autonomie operieren kann und nach dem Einsatz Anpassungsfähigkeit zeigen kann, und das für explizite oder implizite Ziele aus den Eingaben, die es erhält, ableitet, wie es Ergebnisse wie Vorhersagen, Inhalte, Empfehlungen oder Entscheidungen erzeugen kann, die physische oder virtuelle Umgebungen beeinflussen können;

Um hier den Überblick nicht zu verlieren, sollte sich das Augenmerk auf folgende Schlüsselbegriffe richten:

- (Maschinengestütztes System) obviously

- Gewisser Grad an Autonomie

- Anpassungsfähigkeit

- Ableitungsfähigkeit

- Beeinflussung der Umgebung

Letzteres schließt wohl KI, die rein Privat oder im Labor betrieben wird vom Anwendungsbereich der Verordnung gänzlich aus.

Das entscheidende Merkmal, das KI-Systeme von“normaler” Software unterscheiden soll, ist wohl der gewisse Grad an Autonomie. Ein durchaus abstrakter Begriff, der aber so verstanden werden könnte, dass das System fähig sein soll, zu einem gewissen Grad von menschlichem Wirken unabhängig zu funktionieren.

Zum ursprünglichen Entwurf hinzugekommen sind die Anpassungs- und Ableitungsfähigkeit von KI-Systemen. Ersteres stellt klar, dass es sich nicht um statische regelbasierte Software handeln muss und ist ein Wink mit dem Zaunpfahl in Richtung selbstlernender Algorithmen (Stichwort: Machine Learning).

Interessant und meiner Ansicht nach nicht unbedingt klar ist die Fähigkeit des Systems aus den Eingaben (Prompt) abzuleiten, wie Ergebnisse (Output) erzeugt werden können. Der Output muss also irgendwie auf den Input zurückzuführen sein. Wie genau das aussieht wird sich zeigen.

Endlich lässt sich festhalten, dass die Definition des Artikel 3 Absatz 1 die ganze Sache nicht sonderlich verständlicher macht. Die Begriffe sind abstrakt, überschneiden sich in Teilen und lassen einen erheblichen Auslegungsspielraum zu.

Das ist natürlich nicht zwingend negativ. Ein so weiter Begriff schafft Flexibilität für künftige technische Entwicklungen. Andererseits ist damit allerdings auch eine Rechtsunsicherheit verbunden, die Unternehmer abschrecken könnte ihr System auf dem europäischen Markt bereitzustellen.

Die aller meisten Jurisdiktionen mit Ausnahme von Kanada und einiger US-Bundesstaaten haben noch gar keine legislative Definition für KI. In dieser Hinsicht sticht Europa also in weitgehend unbekannte Gewässer.

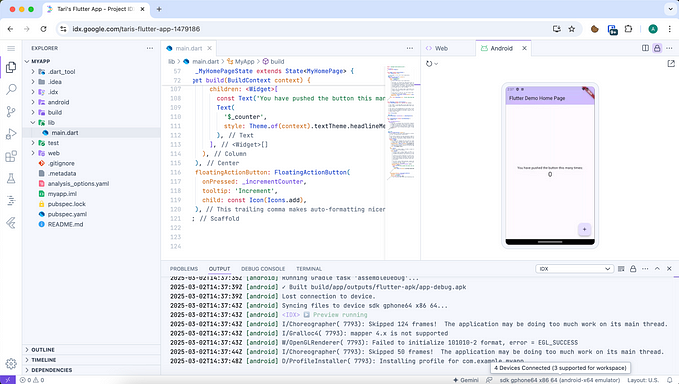

Der Regulierungsansatz

Der Regelungsansatz der KI-Verordnung umfasst insbesondere vier ganz wesentliche Punkte:

Einstufung von KI in Risiko-Level

Markenzeichen des AI Acts ist wohl jetzt schon der sogenannte Risiko-basierte-Ansatz:

KI-Systeme, die unannehmbare Risiken darstellen, sind demnach gemäß Artikel 5 der Verordnung gänzlich verboten. Dazu gehören insbesondere soziale Bewertungssysteme, biometrische Kategorisierungs- oder Identifizierungssysteme und irgendwie den einzelnen Menschen unterschwellig manipulative KI-Systeme.

Kapitel 3 der Verordnung — und damit ihr verhältnismäßig größter Teil — befasst sich mit KI-Systemen, die ein hohes Risiko darstellen, weil sie besonders sensible Bereiche wie Sicherheit und Gesundheit der Bürger betreffen. Sie sind zwar erlaubt, unterliegen aber strengen Regeln und Verpflichtungen.

Einige — eher wenige — Regeln treffen KI-Systeme mit begrenztem Risiko. Für sie gelten insbesondere einige Transparenzpflichten. Wichtig war es dem Gesetzgeber hier wohl, dass die Endnutzer sich darüber im Klaren sein sollen, dass sie gerade mit KI interagieren.

Die Verpflichteten und Geknechteten

Primär vom AI-Act verpflichtet werden die Entwickler der KI-Systeme. Die Anbieter (resp. Entwickler) sind im Sinne des Artikel 3 Absatz 3 der Verordnung diejenigen, die beabsichtigen ein KI-System in der EU in Verkehr zu bringen oder in Betrieb zu nehmen.

Sie sind dabei Verpflichtete unabhängig davon, ob sie in der EU oder in einem Drittland ansässig sind und ob sie das KI-System entgeltlich oder unentgeltlich zur Verfügung stellen.

Die Anbieter treffen je nach Risiko-Level unterschiedliche Anforderungen. Die Anbieter von KI mit hohem Risiko müssen bspw.:

- Ein Risiko- und Qualitätsmanagementsystem für den gesamten Lebenszyklus der KI bereitstellen

- Ein gewisses Maß an Robustheit, Genauigkeit und Cybersicherheit gewährleisten

- Eine ganze Reihe an technischen Unterlagen und Gebrauchsanweisungen zur Verfügung stellen können

- Data-Governance durchführen, um sicherzustellen, dass die Trainingsdaten relevant, repräsentativ und so weit wie möglich fehlerfrei und vollständig sind.

Allzweck-KI-Systeme

Neben dem Risiko-basierten-Ansatz können KI-Systeme auch Anforderungen treffen, weil sie sogenannte Allzweck-KI-Systeme (GPAI = General Purpose AI) sind.

Allzweck-KI-Systeme bzw. -Modelle zeichnen sich durch eine signifikante Allgemeinheit aus und die Kompetenz ein breites Spektrum unterschiedlicher Aufgaben auszuführen. Allzweck-KI-Systeme können dabei auch als KI-Systeme mit hohem Risiko genutzt oder in diese integriert werden.

Die Anbieter von solchen Systemen oder Modellen treffen dabei grundsätzlich folgende Pflichten:

- Die technische Dokumentation auch für nachgelagerte Anbieter

- Eine Politik zur Einhaltung der Urheberrechtsrichtlinie (2019/790)

- Die Veröffentlichung einer hinreichend detaillierten Zusammenfassung der für das Training des Modells verwendeten Inhalte.

Ersteres müssen Anbieter von Systemen mit freier und offener Lizenz nicht erfüllen.

Stellen GPAI-Modelle hingegen ein systemisches Risiko dar — das ist der Fall, wenn der kumulierte Rechenaufwand für die Ausbildung mehr als 1025 Gleitkommaoperationen (FLOPs) beträgt — müssen die Anbieter zusätzlich einige Anforderungen die Transparenz, Sicherheit und Dokumentation betreffend erfüllen.

Erkenntnis

Dieser umfassende Regelungsansatz ist in der Tat weltweit einzigartig. Einen anderen — etwas vorsichtigeren — Ansatz hat bspw. das Vereinigte Königreich gewählt, indem es sich selbst einen sektorübergreifenden fünf-Prinzipien-Katalog für die Regulation von KI vorgibt. Dieser ist (noch) kein Gesetz, die Regulatoren der einzelnen Sektoren müssen sich für künftige Gesetze allerdings daran orientieren und ggf. bestehende Gesetze anpassen.

Hemmt der AI Act Innovation in Europa?

Den unaufhaltsamen Wahn einen von Kopf bis Fuß durchregulierten digitalen Binnenmarkt zu schaffen in aller Gänze würdigend, soll abschließend nun doch noch etwas Grundsatz-Kritik geübt werden.

Zunächst kann der sachliche Anwendungsbereich des AI Acts in Teilen unverständlich wirken. Denn neben der durchaus abstrakten Definition von KI — die sich mit etwas Sachverständnis einigermaßen in Griff bekommen lässt — ist beispielsweise gemäß Artikel 2 Absatz 3 die Anwendung der Verordnung auf Militärische oder Verteidigungspolitische Zwecke ausgeschlossen. Das kann zu dem kuriosen Ergebnis führen, dass fiese KI-gesteuerte Killer-Drohnen gar nicht reguliert werden, während freundliche KI-Avatare, die Bürgern hilfreiche Gesundheitstipps geben, sehr hohe bürokratische Anforderungen bewältigen müssen.

Auch der personelle Anwendungsbereich ist teilweise unbefriedigend, denn der AI Act ist grundsätzlich unabhängig von der Größe des Anbieter-Unternehmens anwendbar. Wie wir gesehen haben, wird die Verordnung voraussichtlich — wie viele andere EU-Rechtsakte — einige Ressourcen für ihre Umsetzung abfordern. Das kann zu einem Wettbewerbsnachteil für kleinere europäische Unternehmen und Start-Ups führen. Im Vergleich zu den US-amerikanischen Tech-Monopolisten haben diese häufig nicht die gleichen Möglichkeiten und Compliance-Mannschaften dem bürokratischen Aufwand ohne weiteres Herr zu werden.

Letztlich birgt der AI Act ein größeres Potential für Rechtsunsicherheit. Um Innovationsoffene Regeln zu schaffen, wird handwerklich auf die Einbindung einer ganzen Reihe abstrakter Elemente zurückgegriffen. Artikel 96 sieht zwar zukünftig eine Latte an Leitlinien durch die Kommission zur praktischen Durchführung der Verordnung vor, die Umsetzungsfristen für Unternehmen sind daran allerdings nicht gebunden, sodass das große Rätseln jetzt schon beginnen muss.

Zudem gibt es Unsicherheiten im Zusammenhang mit anderen (teilweise noch kommenden) Rechtsakten der EU. So ist der AI Act Teil eines Tsunamis von EU-Rechtsakten den digitalen Binnenmarkt betreffend, die gerade in kurzen Zeitabständen an den Start gehen. Unstimmigkeiten mit dem Data Act, der KI- sowie Produkt-Haftungs-Richtlinie sind absehbar und sorgen für mehr Rechtsunsicherheit bei den Anwendern. Auch das Verhältnis zur schon länger bestehenden — und etwas in die Jahre gekommenen — DSGVO ist in Teilen unklar was zum Beispiel die Verarbeitung von personenbezogenen Daten im Rahmen eines automatisierten KI-Trainings angeht.

Fazit

Was bleibt ist, in Anbetracht der oben geübten Kritik wohl nicht ganz ungerechtfertigt, eine Menge unzufriedener Stimmen, die die Nützlichkeit des AI Acts für den europäischen Binnenmarkt zumindest in Zweifel stellen. Geschuldet sind die in Teilen unnötigen Fehler vermutlich nicht zuletzt der durchaus überstürzten Herangehensweise in Brüssel mit Hinblick auf die Europawahlen dieses Jahr.

Es lassen sich meiner Ansicht nach aber auch einige wirklich gute und innovative Regulierungskonzepte erkennen, die Hoffnung machen. So ist die DSGVO ebenfalls bis heute nicht unumstritten, setzte weltweit aber doch einen respektierten Standard.

Letztlich bleibt es abzuwarten wie sich das Ganze entwickelt. Die rechtliche Bedeutung des AI Acts ist jedenfalls wegen des weiten Anwendungsbereichs nur schwer zu überschätzen und trotzdem nur ein kleiner Teil einer Front aus Richtlinien und Verordnungen, die die IT-Rechts-Landschaft in Deutschland und Europa wie nie zuvor verändern wird. Was entsteht? Nun, eigentlich wie immer: ein mittelmäßig sinnvoller Normen-Dschungel für Unternehmer und ein Paradies für Anwälte und Berater.

- Website: recht-kreativ.org

- Ko-fi: ko-fi.com/rechtkreativ